こんにちは、エクサウィザーズAIエンジニアの柳元です。

今回はGTC Japan 2018の参加報告として、いくつかの展示や講演の簡単な紹介をしていきます。

スポンサー展示

株式会社コンピュータマインド様

物体検出・分類の事前学習モデルを提供するライブラリの展示です。

一般的なライブラリと異なり、学習ではなく推論に特化することで、高速に推論結果を得られます。

主にC/C++で実装されており、依存するライブラリ数が少なく、導入も容易です。

追加学習機能も今後実装予定とのことです。

物体検出・分類の事前学習モデルを提供するライブラリの展示です。

一般的なライブラリと異なり、学習ではなく推論に特化することで、高速に推論結果を得られます。

主にC/C++で実装されており、依存するライブラリ数が少なく、導入も容易です。

追加学習機能も今後実装予定とのことです。

コマツ様

大迫力のショベルカーの展示です。

単眼カメラから人を検出し、その距離を検出します。

また、地形を変えるのは本来高い技術を必要とされる作業ですが、

GNSSアンテナから得られる位置情報に基づき、バケットが設計面に沿って自動で動きます。

そのため、アームレバー操作のみで作業ができます。

大迫力のショベルカーの展示です。

単眼カメラから人を検出し、その距離を検出します。

また、地形を変えるのは本来高い技術を必要とされる作業ですが、

GNSSアンテナから得られる位置情報に基づき、バケットが設計面に沿って自動で動きます。

そのため、アームレバー操作のみで作業ができます。

3つのディスプレイのうち、上2つが人検知、下1つが地形情報を表しています。

3つのディスプレイのうち、上2つが人検知、下1つが地形情報を表しています。

ヤマハ様

自動運転ワンマイルモビリティの展示です。

ハンドル・ブレーキ・アクセルがなく、レベル4の自動運転(特定の場所でシステムが全てを操作)を目指しています。

例えば、ゴルフ場やホテルに導入することで、ゲストは施設内を自由に移動することができます。

自動運転ワンマイルモビリティの展示です。

ハンドル・ブレーキ・アクセルがなく、レベル4の自動運転(特定の場所でシステムが全てを操作)を目指しています。

例えば、ゴルフ場やホテルに導入することで、ゲストは施設内を自由に移動することができます。

ピュア・ストレージ様

AIインフラストラクチャであるAIRIの展示です。

Deep learningなどの機械学習に用いるAIサーバは高価であるため、サーバを増やすだけ性能が上がることが望ましいと考えられ、

そのためには継続的パラメータチューニングが必要とされます。

AIRIにはコストパフォーマンスを最大化するための最適化が施されています。

AIインフラストラクチャであるAIRIの展示です。

Deep learningなどの機械学習に用いるAIサーバは高価であるため、サーバを増やすだけ性能が上がることが望ましいと考えられ、

そのためには継続的パラメータチューニングが必要とされます。

AIRIにはコストパフォーマンスを最大化するための最適化が施されています。

パナソニック様

監視カメラから特定の人物を検出する顔認証技術を搭載したセキュリティシステムFacePROの展示です。

事前にある人物の顔情報を登録しておけば、サングラスやマスクをつけた状態であったとしてもその人物を検出できます。

監視カメラから特定の人物を検出する顔認証技術を搭載したセキュリティシステムFacePROの展示です。

事前にある人物の顔情報を登録しておけば、サングラスやマスクをつけた状態であったとしてもその人物を検出できます。

講演

尾形哲也先生

「ディープニューラルネットの力学的構造設計による複数動作の統合」というタイトルで

ロボットの学習方法に関する発表をして頂きました。

モーションプリミティブとは、人間のほとんどの動作を構成する要素のことで、組み合わせたり、並べたりすることで、複雑な動作を生成することができると言われています。

モーションプリミティブは、軌道を構成するそれぞれの値によって表現されるのではなく、

軌道パターンによって表現される、と述べられました。

LeCunのケーキは学習の難しさ(あるいは知能における重要さ)を表しており、そのことがモーションプリミティブの獲得に強化学習が常に最適であるとは言えず、予測学習も重要である、と述べられました。

尾形先生はエクサウィザーズロボット事業の技術顧問でもあります。

株式会社日立製作所様のブースと並んで

エクサウィザーズブースの秤量デモや昨年の双腕型マルチモーダルAIロボットをご紹介頂きました。

尾形先生はエクサウィザーズロボット事業の技術顧問でもあります。

株式会社日立製作所様のブースと並んで

エクサウィザーズブースの秤量デモや昨年の双腕型マルチモーダルAIロボットをご紹介頂きました。

長井隆行先生 「人と共存するこれからのAI x ロボティクス」というタイトルで、 ロボットを通してヒトを理解する取り組みに関する発表をして頂きました。 理解とは予測であり、感情とは自分自身に対する予測であるとし、ロボット工学における感情の研究が必要であることを述べられました。 シミュレーション上で赤ちゃんを模したエージェントに、母親の表情(感情)を模倣させる学習させる研究において、エージェントにとって完全に予測不能な恐怖信号が時折与えられる環境下では、全ての信号が予測可能な環境に比べて複雑な感情表出をするようになるという結果が得られ、その内部表現を低次元に圧縮・プロットすると喜怒哀楽がまるで感情の円環モデルのようになった、というのがとても面白いと思いました。

浅谷学嗣(先生) 「マルチモーダルAIによる協働ロボットの行動獲得・制御の可能性」というタイトルで発表しました。 発表の詳しい内容は、本ブログの後編として後日UP予定ですので、是非ご覧ください!

Dieter Fox先生

“Robotics research at NVIDIA”というタイトルで自身の研究内容について発表頂きました。

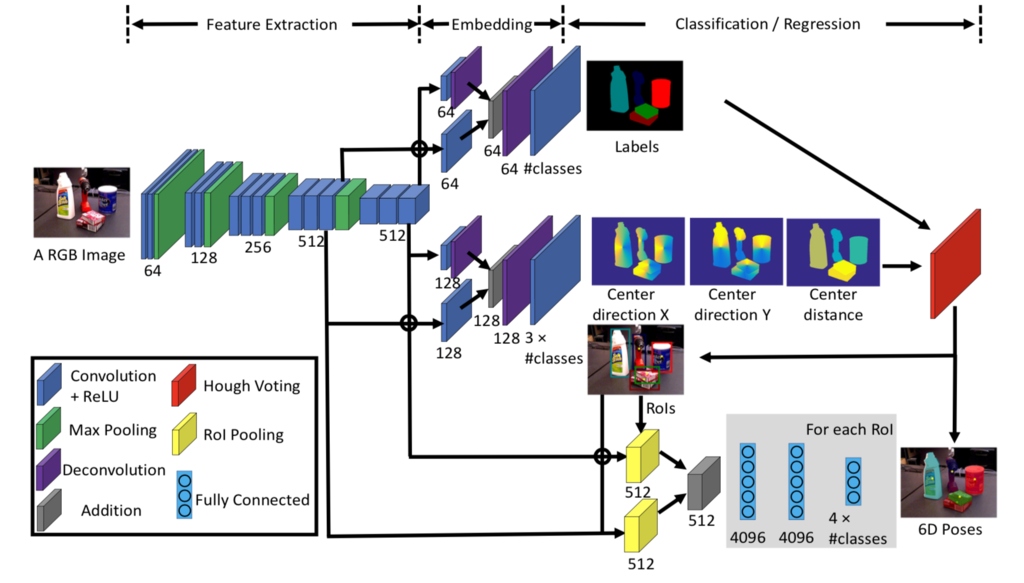

研究テーマの1つに、物体の6D姿勢推定(3D translation + 3D rotation)があります。

ロボットが人とインタラクティブに学習したり、協働するためには、実世界という環境を認識できる必要があります。

しかし、物体の6D姿勢推定は簡単な問題ではなく、物体それぞれが異なる形状を有しており、加えて外観も照明条件や周囲環境の乱雑さ、物体間のオクルージョンの影響を大きく受けるからです。

従来的には、特徴点のマッチングやテンプレートベースな手法が使われていますが、それぞれテクスチャとオクルージョンの問題を抱えています。

ここで紹介されたPoseCNNは、6D姿勢推定のための汎用フレームワークとなるend-to-endな畳み込みニューラルネットです。

上図のように、姿勢推定タスクに必要な要素を切り分けることで、ネットワークがそれらの関係性を明示的にモデル化します。

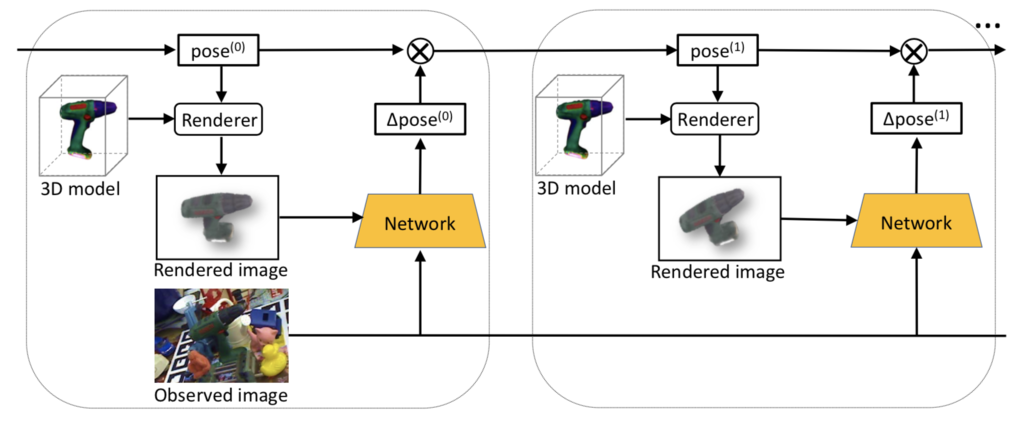

また、DeepIMは推定結果をさらによいものにします。

上図のように、姿勢推定タスクに必要な要素を切り分けることで、ネットワークがそれらの関係性を明示的にモデル化します。

また、DeepIMは推定結果をさらによいものにします。

姿勢推定結果が与えられると、画像中の物体がレンダリングされた視野と一致するSE(3)変換を予測します。

これを反復することにより、正確な姿勢を推定することができます。

液体:https://arxiv.org/pdf/1703.01564.pdf

姿勢推定結果が与えられると、画像中の物体がレンダリングされた視野と一致するSE(3)変換を予測します。

これを反復することにより、正確な姿勢を推定することができます。

液体:https://arxiv.org/pdf/1703.01564.pdf

おわりに

エクサウィザーズのブースにはたくさんの人に見に来て頂き、盛況のうちに終了しました。

また、講演にもたくさんの方にお集まり頂きました。

足を運んでくださった皆様、ありがとうございました!

また、講演にもたくさんの方にお集まり頂きました。

足を運んでくださった皆様、ありがとうございました!

なお、エクサウィザーズは優秀なエンジニア、社会課題を一緒に解決してくれる魔法使い“ウィザーズ”を募集していますので、 ご興味を持たれた方はぜひご応募ください。

ExaWizards Engineer Blogでは、定期的にAIなどの技術情報を発信していきます。 Twitterで更新情報を配信していきますので、ぜひフォローをよろしくお願いします!

おまけ

- 何をしているのでしょうか?

- データの収集をしています。カメラのブレ、認識対象物以外の物体(人の手など)の映り込みや移動に対して ロバストな表現を学習できるような訓練データを効率的に集められるのが上の浅谷式です。 動画はこちら